Booster vos MLP

L’objectif de ce travail de bachelor était d’implémenter le calcul d’un facteur appelé Lambda Happy, utilisé pour résoudre des modèles linéaires sparse. Ce facteur agit comme un poids de pénalisation sur les coefficients non nuls, forçant le modèle à ne conserver que les variables les plus pertinentes.

Le principal défi résidait dans le temps de calcul élevé du Lambda Happy, nécessitant des optimisations. L’algorithme devait être intégré dans Python via un package dédié.

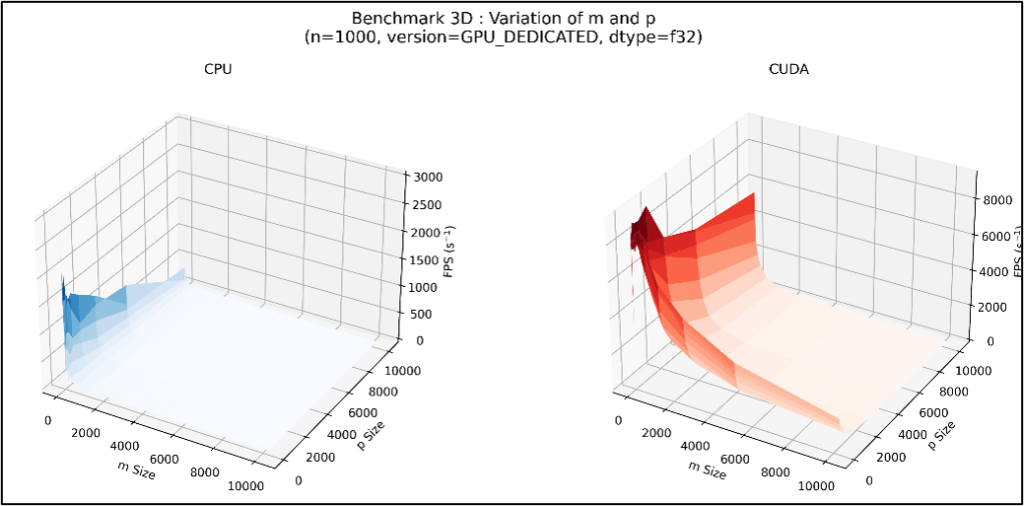

Deux implémentations principales ont été réalisées pour accélérer le calcul : la première avec PyTorch, un framework Python pour le calcul sur tenseurs, et la seconde avec des kernels et bibliothèques CUDA, une plateforme de calcul parallèle développée par NVIDIA.

C’est cette dernière, combinée à un algorithme multi-GPU, qui a donné les meilleurs résultats.

Un binding Python-C++ a également été effectué pour intégrer l’implémentation dans un package Python. Le package a été publié et peut être installé sous Linux.

Les résultats obtenus sont prometteurs, passant de 0,4 FPS sur la première version à plus de 2′104 FPS, soit un facteur d’amélioration de 5′260. Ces performances sont basées sur des matrices de taille fixe, dont un dataset de dimension 1000 par 1000, et peuvent varier selon le matériel utilisé.

Ce facteur peut aussi être utilisé dans les réseaux de neurones sparse. Des algorithmes ont déjà été proposés et pourraient constituer une continuation de ce travail.

Poster du travail de bachelor de Sevan Yerly